凛冬将至:从wave computing的倒下谈AI加速器的未来

2020-04-23 12:29:40 MikesICroom EETOP

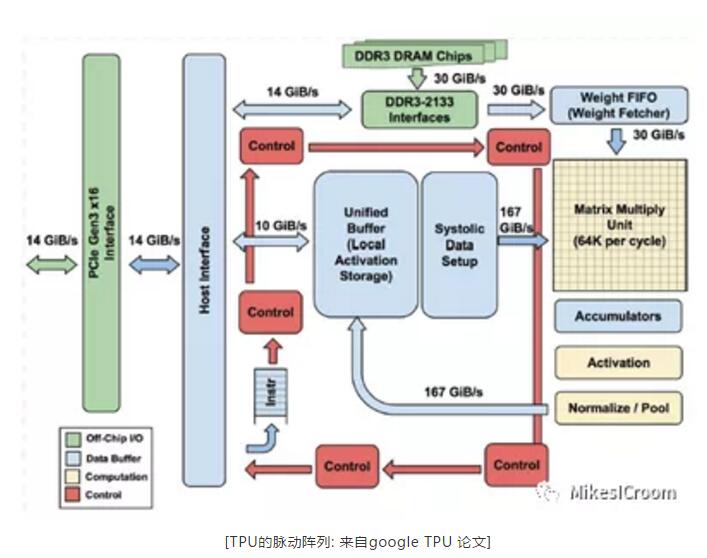

时间回到2016年,随着alpha go在围棋领域击败人类最优秀的棋手,加上Alexnet在图像识别领域超越人类的准确率,标志着机器有可能在某些领域超越和代替人类。这类算法的特点是采用深层次的图结构进行推断,其中包含大量的参数和计算需求,从了催生了对芯片算力的极大挑战。传统的CPU根本无法提供这样的计算能力,因此具有可编程性的GPU走向前台成为了深度学习的主力。其中NVIDIA的GPU因为其提供了CUDA这样的通用并行编程语言而具有很强的编程性和灵活性,称为这个领域绝对的霸主。在深度学习算法向各个领域渗透和挖掘的过程中,工程师们注意到这种特殊的运算在GPU上并不能获得很好的性能功耗比,主要原因是GPU提供了各个精度的高并行的科学运算,而深度学习通常只需要低精度的乘累加运算,这样并不能充分利用GPU的运算能力。因而催生出设计针对深度学习特有运算的加速器,通过牺牲通用性来获得该领域的专用加速。Google是最初尝试的一批公司,第一代TPU突破性的只使用INT8进行推理,舍弃了传统的浮点运算,这样用更小的面积和功耗获得了更大的算力。TPU 1.0的推出可以算是AI专用芯片领域的开拓者。

随着AI热潮的兴起,芯片这个资本市场的冷门领域第一次获得了如此高的关注,在非常短的时间里,大大小小的AI芯片公司雨后春笋般蓬勃发展起来,各种领域,各种规模,各种架构的都有公司涉猎。随着AI算法在图像和语音领域的高速发展,在这两个方面有较大需求的互联网和手机公司也纷纷加入战局,比如苹果和华为都很快推出了各自手机的神经网络加速器,用来提高摄像和面容识别的速度和准确度。互联网巨头们也不甘落后,Google,百度,阿里都在很短时间里组建了自己的硬件设计团队并推出了各自的加速器和编程框架。在各家的宣传中,对GPU的性能可以说都是数十倍的提升。其中wave computing的DPU架构算是其中的佼佼者,全异步电路,数据流执行,非冯架构的众核可重构结构,哪一项放出来都是芯片设计中的尖端方向。从他给出的测试数据来看,等效6.7GHz的频率,连intel都要望其项背。即使wave AI芯片不成功,这些技术的研究总也是很有前景的,而这样的公司也要走向破产申请之路,不免让人有些疑惑,到底是技术错了,还是市场错了?

这里我并不想质疑wave所宣扬的技术创新是否可行,而希望从最近AI芯片不利的消息中,谈谈对AI芯片未来发展的个人看法。随着全球经济不可避免的下滑和资本市场的冷却,wave的倒下可能只是个开始,也就是说之后就是潮水褪去的裸泳时代了。从AI芯片抛物线式的发展历程来看,目前高端AI市场最大的赢家,也很有可能是未来很久的赢家,就是NVIDIA。其他面向这个领域的玩家,包括wave在内,并没有对NV造成实质性的威胁,其中的关键是无法挑战庞大的CUDA生态,没有良好的编程性和通用性,再高的性能也很难在实际的应用中发挥效果。在中端领域,这个市场被几大手机厂商所瓜分,包括苹果,华为,三星,高通,ARM。由于图像是AI领域最成熟的方向,并且可以很明显的提升手机摄像和识别的效果,因此各厂商都有动力开发这样的专用加速器,并且是各自开发来保证差异性和控制力。至于低端领域,不客气的说,AI芯片没有低端领域,一个ARM CPU加上DSP和NEON扩展足以应付绝大多数的应用。从各场景上来看,AI芯片的创业其实是夹缝中生存,高端没有强大生态,中端各厂家只想自己玩,低端没有应用场景。因而大多数的AI芯片创业公司,除了开几场发布会,发布一些耀眼数据,跑跑benchmark,并没有办法找到合适的应用场景,因此只能靠融资一轮一轮的支持,不能创造经济价值。而目前的经济形势有可能是压倒骆驼的最后一根稻草,这也可能是wave面临的现状。

芯片从本质上来说和其他的商品并没有不同。要能卖出去创造价值,关键是要有合适的场景,并且要有“非我莫属”的杀手级应用出现,促使整个行业向包含AI芯片的方向发展。从目前来看,这样的杀手级应用似乎还没出现。AI行业的发展,不是靠各个会议中所提出的五花八门的模型,以及像换脸作曲打游戏这样的娱乐级应用,而是需要一个像手机中的“iphone”,汽车中的“特斯拉”这样的产品出现,向大家宣布,这就是未来,将从根本上改变人们之后的生活。而这个未来中,AI芯片是必不可少的重要一环。这也许需要时机,也需要一个像乔布斯,马斯克这样的开拓者。

从技术上来说,wave computing所面临的的问题也许标志着第一波AI创业者们方向性的错误。过份的追求性能,功耗,牺牲了通用性和编程性,造成在实际应用上的编程困难和不可移植。从整个算法领域来看,AI目前所在的深度学习也许算是一个专用领域,但从AI自身的算法看,它仍然是通用的,是需要有适应算法和模型变化的能力的,不管是图像,语音,仿生,都不会是一个一成不变的算法,而是会一直演进下去。哪怕是成熟的算法,对于不同的应用,仍然会有各种各样的区别,这样都需要AI芯片能够快速且高性能的适配。除非一个领域的算法发展为几乎固定,比如视频的H.264,加密的AES,这样ASIC的固定算法就具有绝对优势,可以不考虑编程性,否则可编程和可移植一定是最重要的因素,甚至是第一要素,而显然AI不会是个固定的算法。因此,如何在目前的各种AI加速的硬件架构上,提供足够好的编程性,会是之后AI芯片设计的重点。从这个角度来看,目前走在这条道路上的公司寥寥无几。其中除了目前成功的GPGPU结构外,类VLIW的加速器也是可能的方向之一,如Habaha的Goya和Gaudi,华为的DaVinci,燧原的DTU。至于能否占据先机,更关键的是完善的生态,这也是最难的一步。然而随着Habana的被收购,不免让人疑虑重重,这些小的AI创业公司们能否有机会成长为参天大树,还是只能在资本和市场的困境中无奈的选择被巨头并购?还是很希望有创业公司能够成长壮大,像Google对于搜索,像阿里对于互联网商务,像NVIDIA对于图形和AI。芯片这个资本和技术并重的行业,需要这样的搅局者和开拓者来打破僵局,推动它向更高更强的方向发展。

更多干货,欢迎关注公众号:MikesICroom 回复“课程”获取斯坦福大学AI加速器课程资料